Overview

- Graph RAG workflow 이해하기

- 지식그래프(KG)를 어떻게 설계하는가 ?

- 지식그래프 설계 자체가 정해진 틀을 무조건 따를 필요는 없다 -> 신뢰할 수 있는 그래프 구축의 필요성

- [5] LinearRAG: Linear Graph Retrieval Augmented Generation on Large-scale Corpora -> Tri-Graph 방법론 제시

- Knowledge Graph vs. Tri-Graph

- 도메인 특화된 지식 그래프는 어떻게 설계할까 ?

- 의료도메인: [4] Medical Graph RAG: Evidence-based Medical Large Language Model via Graph Retrieval-Augmented Generation (ACL 2025)

- UMLS(Unified Medical Language System) 라는 공신력있는 의료사전에서 엔티티를 추출하였음

- 지식그래프 설계 자체가 정해진 틀을 무조건 따를 필요는 없다 -> 신뢰할 수 있는 그래프 구축의 필요성

- 잘 설계된 KG를 기반으로 어떻게 검색해야할까 ?: Knowledge Retrieval Techniques and Strategies

1. Graph Retrieval-Augmented Generation (Graph RAG) 개요

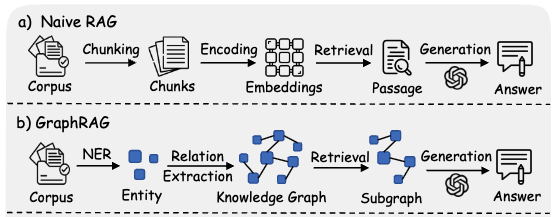

1-1. Workflow of GraphRAG (VS. Naive RAG)

- 지식 구성(Knowledge Organization)

- 목표: 외부 정보를 효율적으로 구조화하여 빠르고 관련성 높은 정확한 검색을 가능하게 합니다. 전통적인 RAG가 텍스트를 단순한 청크로 나누어 벡터 데이터베이스에 저장하는 것과 달리, GraphRAG는 그래프 기반 방법을 사용하여 지식을 체계화합니다.

- Graphs as knowledge carriers: 텍스트에서 추출된 핵심 지식(e.g., 개체, 관계, 요약된 정보)을 명시적인 지식 그래프(KG) 형태로 표현합니다. 노드는 개념을, 엣지는 그 개념들 간의 관계를 나타내어 복잡한 지식 구조를 직접적으로 모델링합니다.

- Graphs for knowledge indexing: 원본 텍스트 청크를 그대로 유지하면서 그래프 구조를 인덱싱 메커니즘으로 활용합니다. 텍스트 청크를 노드로 삼고, 의미적 유사성이나 도메인별 관계에 따라 노드 사이에 엣지를 연결하여 효율적인 정보 접근을 돕습니다.

- 지식 검색(Knowledge Retrieval)

- 목표: 미리 구성된 지식 그래프에서 주어진 사용자의 쿼리에 필요한 관련 정보를 효율적으로 찾아냅니다.

- GraphRAG는 graph-based retrievers 를 사용합니다. 단순히 쿼리와 텍스트 청크 간의 의미적 유사성(semantic similarity)만 고려하는 것이 아니라, 쿼리 유형과 검색된 서브그래프(subgraph) 간의 논리적 일관성(logical coherence) 까지 고려하여 관련 정보를 검색.

- 그래프의 구조적 특성(노드 간의 관계, 다중 홉 추론 경로)을 활용하여 더 정확하고 문맥에 맞는 지식을 가져올 수 있게 합니다.

- 지식 통합(Knowledge Integration)

- 목표: 검색된 지식과 LLM(대규모 언어 모델)의 내재된 지식을 결합하여 일관성 있고 정확한 응답을 생성.

- GraphRAG 모델은 검색된 서브그래프 정보를 입력 쿼리와 함께 LLM에 통합하여 최종 출력을 생성합니다. 검색된 서브그래프 정보의 풍부함을 최종 텍스트 기반 프롬프트에 그대로 유지하면서도, 불필요한 중복을 피하고 중요도가 낮은 측면에 과도하게 초점을 맞추지 않도록 하는 것이 중요.

1-2. Two Type of GraphRAG

- 이미 존재하는 KG 를 활용하는 경우 (Knowledge Graph Question Answering, KGQA)

- WebQSP, CWQ 데이터셋

- [10] EWEK-QA: Enhanced Web and Efficient Knowledge Graph Retrieval for Citation-based Ques-

tion Answering Systems (ACL 2024) - [11] MindMap: Knowledge Graph Prompting Sparks Graph of Thoughts in Large

Language Models (ACL 2024)

- KG 를 직접 설계하는 경우

- [9] Knowledge Graph-Guided Retrieval Augmented Generation (NAACL 2025)

- [4] Medical Graph RAG: Evidence-based Medical Large Language Model via Graph Retrieval-Augmented Generation (ACL 2025)

- [3] PathRAG: Pruning Graph-Based Retrieval Augmented Generation with Relational Paths (AAAI 2026)

- [7] LightRAG: Simple and Fast Retrieval-Augmented Generation (EMNLP 2025)

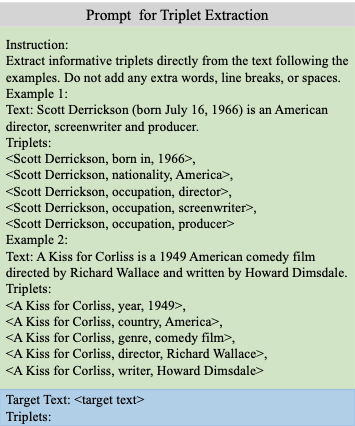

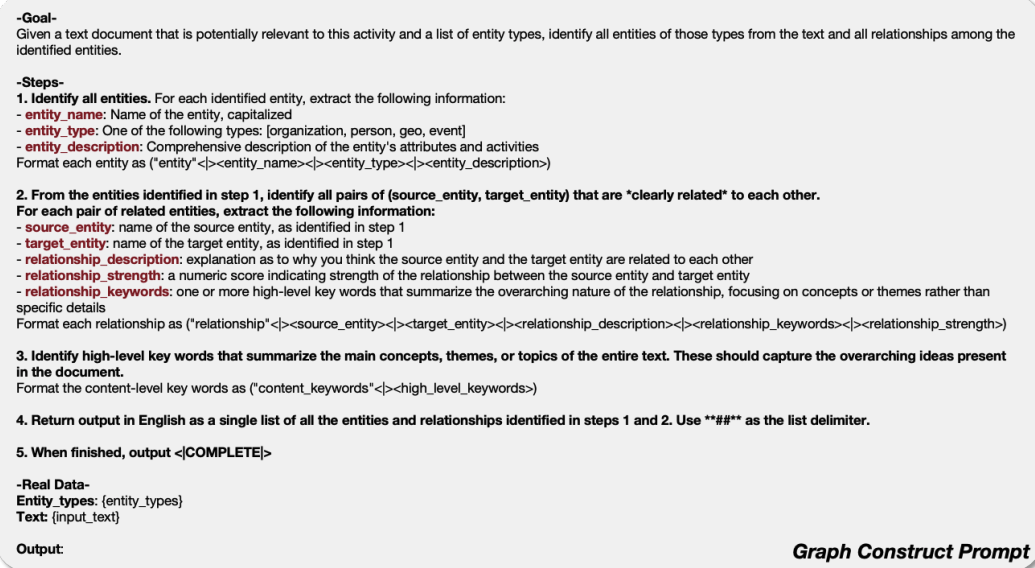

2. Knowledge Graph Construction from Corpus

- 지식 그래프 구축

- 비정형 텍스트 코퍼스(corpus)를 구조화된 지식 그래프로 변환하여 GraphRAG pipeline 에서 정보를 효율적이고 정확하게 검색할 수 있게 합니다.

- LLM이 multi-step reasoning 을 일관성 있게 수행하고, 자연어 처리에서 발생하는 언어적 다양성 문제를 해결하는데 기여

- 접근 방식

- 정보 추출 (Open Information Extraction, OIE): 대규모 텍스트에서 관계형 사실(relational facts)을 자동으로 추출하는 기술에 크게 의존합니다.

- Traditional OIE methods

- [13] Leveraging linguistic structure for open domain information extraction (ACL 2015)

- [14] Openie6: Iterative grid labeling and coordination analysis for open information extraction (EMNLP 2020)

- Advanced OIE methods

- [15] Crawling the internal knowledge-base of language models (EACL 2023)

- [16] Sac-kg: Exploiting large language models as skilled automatic constructors for domain knowledge graphs (ACL 2024) -> 도메인 특화 지식그래프 구축을 위한 프레임워크

- GraphRAG [8], GraphReader [12]와 같은 연구들은 노드에 엔티티, 관계, 유형, 의미적 정렬 등의 추가 정보를 풍부하게 담은 속성 지식 그래프를 구축합니다. 예를 들어, GraphRAG [8] 는 LLM을 활용하여 관련 엔티티에 대한 커뮤니티 요약을 생성합니다.

- 한계점

- 도메인별 온톨로지의 다양성으로 인해 효과적인 KG 구축이 여전히 어렵습니다.

- LLM을 활용한 지식 요약 방식은 높은 토큰 비용과 상당한 런타임 오버헤드를 초래할 수 있습니다.

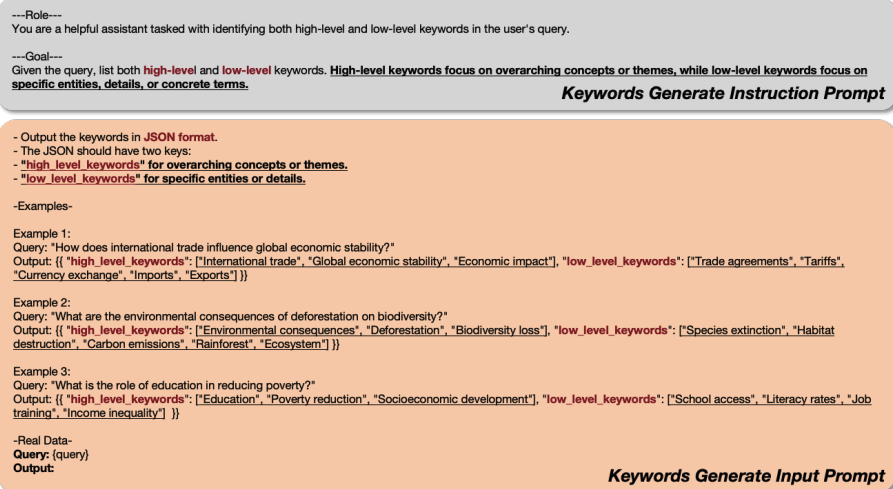

LLM 기반 Relation Extraction / Graph Construction 을 위한 Prompt 예시: [7,9]

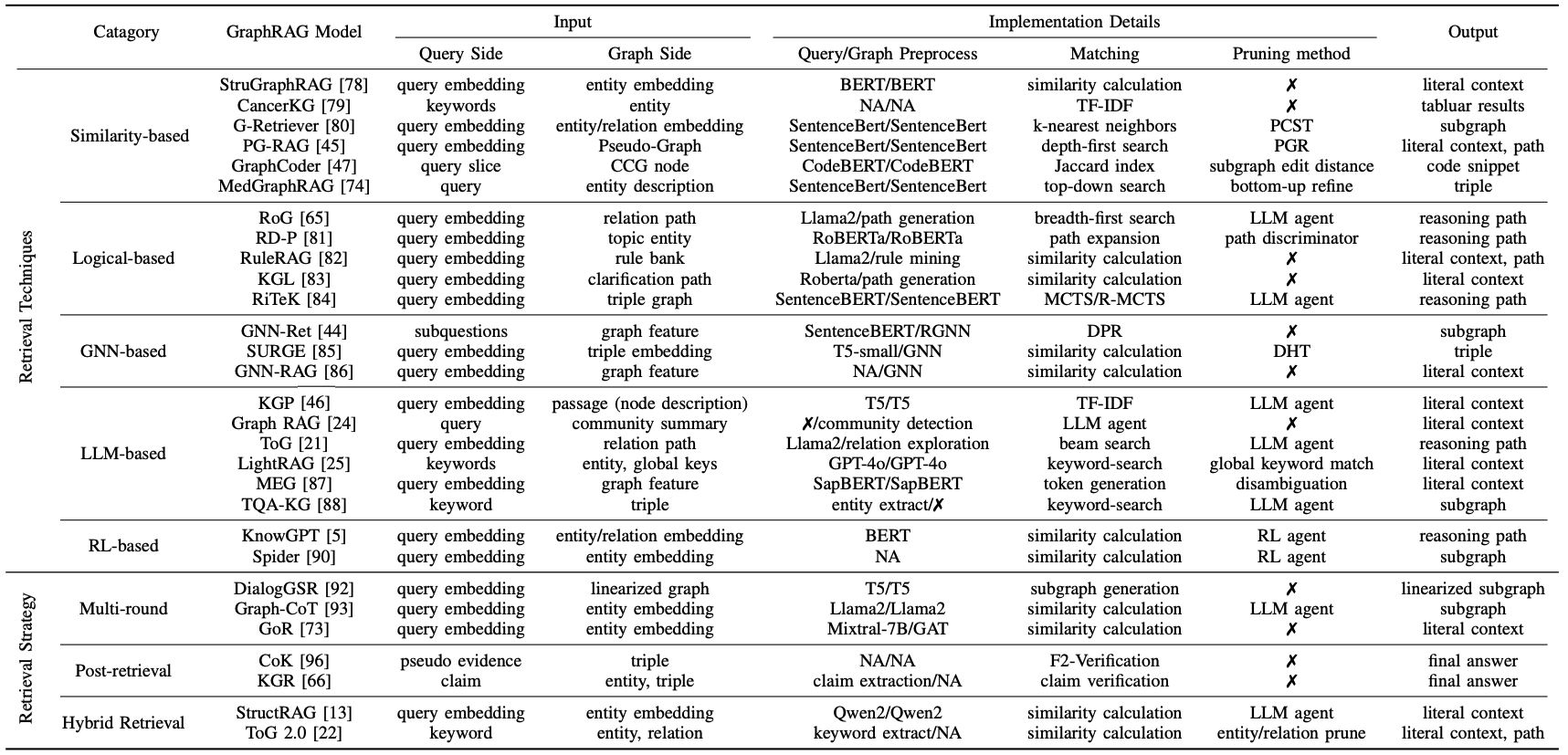

3. Knowledge Retrieval Techniques and Strategies

- Semantic-based approach: Embedding space modeling

- 쿼리와 그래프 요소(개체, 관계 등)를 연속적인 벡터 공간으로 매핑하여 문맥적, 개념적 연결을 평가합니다. 이는 문자열 일치의 제약을 넘어섭니다.

- 사전 훈련된 언어 모델(pre-trained language models)이나 TF-IDF, Word2Vec, GloVe와 같은 워드 임베딩(word embeddings) 기법을 사용합니다.

- 정확한 용어 일치가 없더라도 의미론적으로 관련성이 높은 정보를 검색할 수 있습니다.

- 한계점: 그래프 구조 자체의 고유한 장점(e.g., 노드 간의 복잡한 관계)을 충분히 활용하지 못함.

- GNN-based approach

- GraphRAG 에서의 GNN 기반의 Retriever 활용

- GNN 기반 Knowledge Retrieval 는 주로 구축된 그래프 베이스(graph bases) 내의 노드를 인코딩하는 데 사용됩니다.

- 이 모델들은 쿼리(질문)와 그래프 노드 표현 간의 인코딩 유사성(encoding similarity)을 활용하여 관련성 높은 지식을 찾아냅니다.

- 노드 표현은 단순히 의미적 유사성뿐만 아니라 노드 간의 구조적 관계에 대한 이해도 포함합니다.

- GNN 기반 검색기의 학습

- GNN 기반 검색기는 GNN 인코더를 Pre-training 해야함

- 명시적으로 레이블링된 데이터가 부족한 경우가 많기 때문에, GNN이 노드 표현을 통해 목표 지식을 정확하게 찾을 수 있도록 적절한 손실 함수(loss function)를 설계하는 것이 중요

- GraphRAG 에서의 GNN 기반의 Retriever 활용

- LLM-based approach

- LLM은 질의(query)를 해석하고, 지식 그래프(Knowledge Graph, KG)에 적합한 관련 질의를 생성하며, 지식 베이스(Knowledge Base) 내 여러 소스로부터 정보를 통합하는 데 사용됩니다.

- 이는 쿼리 확장(query expansion), 맥락적 모호성 해소(contextual disambiguation), 맞춤형 검색 경로 생성(tailored retrieval paths)과 같은 작업을 수행하여 전반적인 검색 효율성을 높입니다.

- 지식 그래프 이해 및 서브그래프 식별

- LLM 기반 지식 검색기는 LLM이 그래프를 이해하고 핵심 서브그래프(subgraph)를 식별하도록 하는 데 중점을 둡니다.

- 이는 단순한 의미론적 유사성 기반 방법보다 더 강력한 텍스트 표현을 제공

- 작동 방식

- LLM의 뛰어난 이해 및 생성 능력을 활용하여 질의를 해석하고 적절한 후보 인스턴스를 추출하거나 합성합니다.

- 이후 similarity-based approach 전략을 사용하여 이러한 후보와 그래프 내 노드 간의 유사도를 계산하고, 가장 중요한 서브그래프 세그먼트를 식별합니다.

- 최근연구

- PG-RAG [17]: LLM을 사용하여 질의에 해당하는 핵심 포인트를 생성하고, 유사성 행렬 계산을 통해 그래프 내에서 시작 노드(seed nodes)를 식별합니다. 이 시작 노드로부터 후보 노드를 탐색하고, 각 노드가 시작 노드에 기여하는 정도를 평가하여 가장 기여도가 높은 경로(사실 궤적)를 검색된 정보로 선택합니다.

- Thought Graph [18]: 계층적 트리 구조에서 LLM을 활용하여 생물학적 프로세스 용어를 재귀적으로 확장하고 투표하여 유전자 세트를 가장 정확하게 설명하는 용어 세트를 선택합니다.

- HOLMES [19]: 질의에서 추출된 개체(entity)를 기반으로 개체-문서 그래프(entity-document graph)를 너비 우선 탐색(breadth-first traversal)합니다. LLM의 능력을 활용하여 문서 노드에서 KG 트리플(triples)을 추출하고 이를 하이퍼 관계 KG(hyper-relations KG)로 변환한 후, 관계 임베딩 간의 코사인 유사도를 계산하여 질의와 가장 관련성이 높은 정보만 남도록 가지치기(pruning)합니다.

- LightRAG [7]: LLM-based Dual-level Retrieval Paradigm

- LightRAG [7]

- Dual-level Retrieval Paradigm: 주어진 쿼리의 특성을 고려하여 검색함

- Low-Level Retrieval: 그래프 내 특정 개체(entity)와 관련된 속성 또는 관계에 대한 정확하고 세부적인 정보를 검색하는 데 중점. 구체적이고 세밀한 질문에 적합합니다.

- High-Level Retrieval: 여러 관련 개체 및 관계에 걸친 정보를 종합하여 통찰력을 제공하는 추상적인 질문에 적합합니다.

- Low-Level Retrieval: 그래프 내 특정 개체(entity)와 관련된 속성 또는 관계에 대한 정확하고 세부적인 정보를 검색하는 데 중점. 구체적이고 세밀한 질문에 적합합니다.

- 키워드, 엔티티, 관계의 임베딩간의 유사도 검색

- Dual-level Retrieval Paradigm: 주어진 쿼리의 특성을 고려하여 검색함

- LLM-based Knowledge Retrieval 을 위해 fine-tuning 필요성

- 일반적으로 LLM 기반 검색기는 모델 학습 없이 prompt 사용을 통해 활용할 수 있습니다.

- [20] 검색 결과가 LLM의 기존 지식을 반영하거나 fine-tuning 하는 데 사용되어 능력을 향상시켜야 하는 경우에는 Retriever 학습이 필요할 수 있음.

- 전이 학습(Transferability) 활용

- 관련 연구: [21,22,23]

- LLM이 그래프 관련 작업에서 적은 학습 데이터(few-shot) 또는 전혀 학습 데이터 없이(zero-shot) 전이 가능한 성능을 달성할 수 있음을 보여줌

Reference

[1] Graph Retrieval-Augmented Generation: A Survey

[2] A Survey of Graph Retrieval-Augmented Generation for Customized Large Language Models

[3] PathRAG: Pruning Graph-Based Retrieval Augmented Generation with Relational Paths (AAAI 2026)

[4] Medical Graph RAG: Evidence-based Medical Large Language Model via Graph Retrieval-Augmented Generation (ACL 2025)

[5] LinearRAG: Linear Graph Retrieval Augmented Generation on Large-scale Corpora

[6] https://github.com/DEEP-PolyU/Awesome-GraphRAG?tab=readme-ov-file

[7] LightRAG: Simple and Fast Retrieval-Augmented Generation (EMNLP 2025)

[8] From Local to Global: A GraphRAG Approach to Query-Focused Summarization

[9] Knowledge Graph-Guided Retrieval Augmented Generation (NAACL 2025)

[10] EWEK-QA: Enhanced Web and Efficient Knowledge Graph Retrieval for Citation-based Question Answering Systems (ACL 2024)

[11] MindMap: Knowledge Graph Prompting Sparks Graph of Thoughts in Large Language Models (ACL 2024)

[12] GraphReader: Building graph-based agent to enhance long-context abilities of large language models (EMNLP 2024)

[13] Leveraging linguistic structure for open domain information extraction (ACL 2015)

[14] Openie6: Iterative grid labeling and coordination analysis for open information extraction (EMNLP 2020)

[15] Crawling the internal knowledge-base of language models (EACL 2023)

[16] Sac-kg: Exploiting large language models as skilled automatic constructors for domain knowledge graphs (ACL 2024)

[17] Empowering large language models to set up a knowledge retrieval indexer via self-learning

[18] Thought graph: Generating thought process for biological reasoning (WWW 2024)

[19] HOLMES: Hyper-Relational Knowledge Graphs for Multi-hop Question

Answering using LLMs (ACL 2024)

[20] Reasoning on graphs: Faithful and interpretable large language model reasoning (ICLR 2024)

[21] A survey of graph meets large language model: Progress and future directions (IJCAI 2024)

[22] Zerog: Investigating cross-dataset zeroshot transferability in graphs (KDD 2024)

[23] Graph intelligence with large language models and prompt learning (KDD 2024)

'Research in NLP' 카테고리의 다른 글

| Datasets for GraphRAG Evaluation (0) | 2025.12.22 |

|---|---|

| GraphRAG Survey-2 (0) | 2025.12.15 |

| Contextual Information and Mutual Dependency between words using document graph (4) | 2024.06.10 |

| 논문 읽는 법 , AI 연구를 시작하는 방법 - MIT (0) | 2024.03.07 |

| 연구 가설이란 무엇인가 : 좋은 연구 가설을 세우는 방법 (0) | 2024.03.07 |